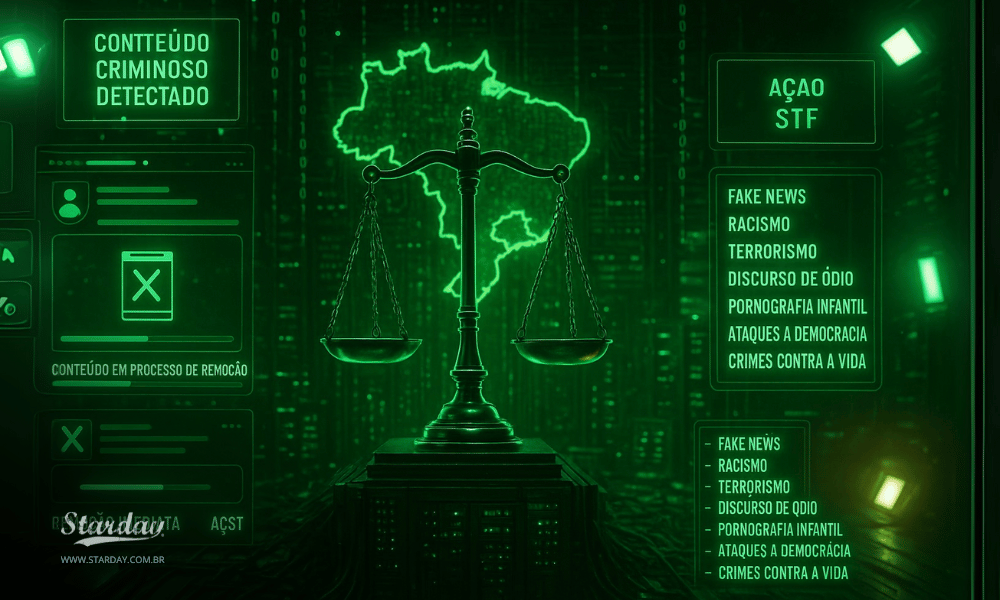

Novas Regras para Remoção de Conteúdo Criminoso em Redes Sociais no Brasil

O Supremo Tribunal Federal (STF) no Brasil ampliou recentemente as responsabilidades das plataformas digitais, determinando que elas devem remover proativamente certos tipos de conteúdo criminoso sem a necessidade de uma ordem judicial prévia. Essa decisão representa uma mudança significativa na regulamentação da internet no país.

Crimes com Remoção Obrigatória Imediata

A lista estabelecida pelo STF inclui sete crimes graves que exigem ação imediata das plataformas para a retirada do material.

Os Sete Crimes Graves com Remoção Obrigatória

Incitação ao ódio e à violência: Conteúdo que promove ou instiga a aversão, discriminação ou violência contra grupos ou indivíduos.

Terrorismo: Qualquer material relacionado a atividades terroristas, incluindo planejamento, incitação ou apologia.

Pornografia infantil: Conteúdo que explora ou abusa sexualmente de crianças.

Disseminação de notícias falsas (fake news) com potencial de dano relevante: Informações comprovadamente falsas que podem causar prejuízos significativos à sociedade, como afetar eleições, saúde pública ou segurança.

Crimes contra a democracia e o Estado de Direito: Conteúdo que visa subverter ou atacar as instituições democráticas e os princípios legais.

Crimes de racismo e discriminação: Publicações que promovem a segregação ou o preconceito baseados em raça, etnia, religião, orientação sexual, etc.

Conteúdo relacionado a crimes contra a vida: Material que glorifica, incita ou auxilia crimes como homicídio, suicídio ou lesões corporais graves.

A expectativa é que as empresas implementem mecanismos eficazes para identificar e eliminar essas postagens, a fim de evitar sua disseminação e o consequente dano.

Responsabilidade das Plataformas e Notificações Extrajudiciais

A Suprema Corte brasileira considera que a ausência de sistemas robustos para detectar e remover conteúdos ilícitos pode caracterizar uma falha sistêmica. Caso essa falha seja comprovada, as plataformas poderão ser responsabilizadas legalmente.

Além disso, a decisão fortalece o uso de notificações extrajudiciais. Isso significa que, ao serem alertadas sobre a presença de material ilegal – como contas falsas, discursos de ódio ou outras atividades ilícitas –, as empresas terão a obrigação de remover o conteúdo. O descumprimento dessa exigência pode levar à responsabilização civil.

Mudança no Marco Civil da Internet

Essa nova orientação do STF modifica o entendimento anterior do Marco Civil da Internet, que geralmente exigia uma determinação judicial para que as plataformas fossem responsabilizadas pela manutenção de conteúdo ilícito. O tribunal justificou a alteração afirmando que o modelo anterior não garantia proteção suficiente à democracia e aos direitos fundamentais, exigindo, assim, uma vigilância mais rigorosa por parte das redes sociais abertas.

Essa medida visa aprimorar a segurança no ambiente digital e garantir que as plataformas atuem de forma mais ativa no combate à criminalidade online.